Depuis quelques semaines, que ce soit au travail ou chez moi, un thème récurrent revient inévitablement dans la conversation : ChatGPT. Cela devient même obsessionel… Le rachat de Twitter par Musk, c’est à côté du pipi de chat, niveau événement. Dans ma dernière livraison, face à la puissance de Dall-E et consort, je me demandais s’il n’était pas temps pour nous d’appuyer sur le bouton pause, de recommencer à regarder autour de nous et d’observer de nouveau le monde qui nous entoure pour éviter un assèchement créatif et une panne de notre capacité à imaginer. En réalité, je touchais à peine du doigt les possibilités de l’IA générative.

J’ai donc testé ChatGPT.

Et j’ai compris que nous entrions définitivement dans l’ère de la Forêt Noire du Net.

Énoncée par Yancey Strickler, le fondateur de Kickstarter, cette théorie du web, qui elle-même s’appuie sur une formulation de l’auteur de science-fiction chinois Liu Cixin, la théorie universelle de la forêt noire, qu’il a développée dans sa trilogie Le Problème à Trois Corps, s’oppose à une autre conception du web, le cozy web.

Un Net tout tranquille parce que…

Le cozy web est cet endroit sur le net, où les internautes se sont réfugiés pour fuir la horde des trolls et autres marketeurs/pubards qui, depuis quelques années, polluent sérieusement le net, nous obligeant à créer des espaces où sont bannies ces pratiques. Ce sont des groupes privées sur Slack, WhatsApp, Framateam ou Telegram ; des espaces de stockage privé ; des listes de diffusion ou encore le bon vieux email. Des espaces tranquilles où la conversation peut se dérouler dans le respect des uns et des autres, sans que l’on soit perturbé par le troll du jour ou par une pub idiote ; un espace où vos données personnelles sont respectées et où vous n’êtes pas surveillé par l’algorithme machin. Bref, cet espace qu’internet aurait toujours dû être.

Ces espaces de conversation dépressurisés se sont multipliés ces dernières années, car ils échappent aux trois règles que les GAFAM veulent nous imposer : l’indexation, l’optimisation et la gamification.

En opposition, la théorie de la forêt noire décrit donc cet espace qui semble étrangement calme et dépourvu de vie. Toutes les créatures vivantes s’y cachent, car « la nuit est le moment où les prédateurs sortent. Pour survivre, les animaux se taisent. »

Avec l’arrivée de l’IA générative, la forêt noire s’étend dangereusement et risque de nous pousser vers un endroit où peu aime s’aventurer (par méconnaissance, la plupart du temps mais quand même), le Dark Net. Les modèles de langage à grande échelle (LLM) sur lesquels reposent les IA génératives généreront des contenus qui passeront haut la main le test de Turing. Depuis six mois, nous sommes, en effet, littéralement envahis par les contenus générés par ces IA. Pour ne pas prendre les plus connus, ils se nomment Jasper, Moonbeam ou Anyword. Ils sont conçus pour produire des textes publicitaires, des articles de blog, des e-mails, des posts de médias sociaux et n’importe quel autre type de contenus marketing. Et devinez quoi ? Ils sont très bons dans ce qu’ils font.

Ces outils produisent un contenu très pertinent, avec une telle rapidité, qu’à ce jour, je pense, il nous est impossible d’en comprendre toutes les implications. Tout comme nous ne mesurons pas encore le choc provoqué par OpenAI avec l’ouverture au public de DALL-E puis de la version light de GPT3, ChatGPT. Nous oscillons entre stupeur et fascination.

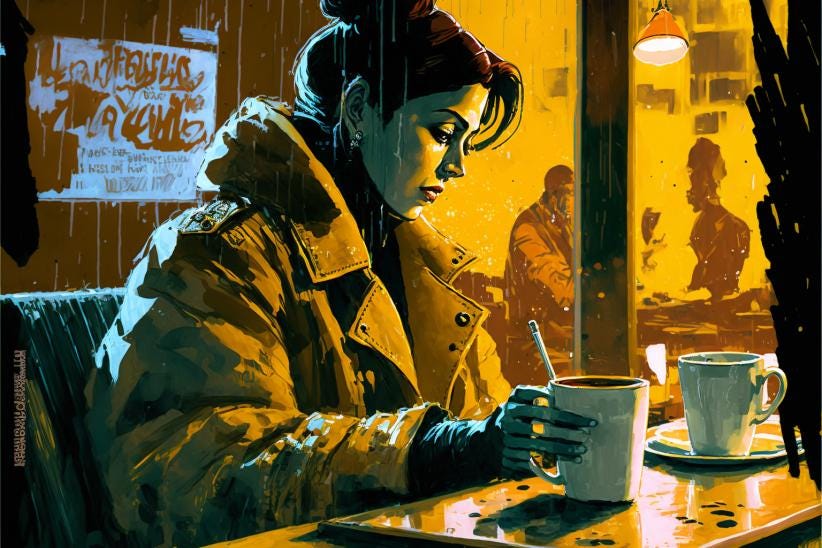

Et pour compliquer le tout, l’évolution de ces outils est tellement rapide qu’il y a de quoi paniquer. Il y a un an, DALL-E et Midjourney produisaient des illustrations assez basiques, à basse résolution. Aujourd’hui, elles créent des photographies ou des illustrations impossibles à distinguer du travail des photographes ou des illustrateurs humains.

Pour preuve, ces illustrations ont été générées par Midjourney, dans des styles très différents.

James C. Scott à la rescousse…

Les plus optimistes d’entre nous ne verront que le verre à moitié rempli. ChatGPT nous épargnera les mémos chiants à rendre à la dernière minute, les documentations techniques à écrire que personne ne lit, etc. Bref, à produire tout le contenu, que nous n’aimons pas faire. Mais, aussi, d’un autre côté, il nous aidera à retoucher certaines formulations maladroites ou à trouver le bon slogan, et ce en quelques secondes.

En résumé, nous allons être vite submergés par du contenu généré et générique.

Car tous les marketeurs et influenceurs mettront en place des routines pour automatiser leur flux de contenus vers les réseaux sociaux et les blogs. Un nombre incessant d’articles corporate, de tweets engageants ou des posts Linkedin pour votre développement personnel envahira nos écrans, sans que nous sachions faire la différence entre l’humain et la machine.

Certains affirment que nous vivons déjà dans un tel maelstrom. Que l’existence de la forêt noire nous a déjà obligés à trouver des solutions alternatives pour préserver cet espace ou plutôt ces espaces, le fediverse en est l’un des exemples les plus remarquables.

Reste que l’on peut se poser tout de même, une question : pourquoi nous nous entêtenons à concevoir et à produire des systèmes complexes qui, au final, ne nous rendent pas la vie la plus facile, mais au contraire nous asservissent et nous manipulent ?

La lecture de l’œuvre de l’anthropologue et politolgue James C. Scott peut nous éclairer, notamment son essai L’œil de l’État. Moderniser, uniformiser, détruire. Il tente de répondre à une question assez simple : comment les États parviennent-ils à connaître et intervenir sur les individus, leurs sociétés et leurs environnements ? Pour résumer ce brillant essai, la réponse se situe dans tous les processus de simplification, d’abstraction et de standardisation qui rendent lisible le monde social et naturel. Celui-ci est rendu manipulable, gérable, administrable grâce à des fictions simplificatrices qui touchent aussi bien nos territoires, nos langues, nos identités, nos transports, nos mondes ruraux, nos façons de se nourrir que nous-mêmes les citoyen·ne·s.

Et se souvenir que dans son dernier discours à Pittsburg, en 2016, le président américain, Barack Obama, avait plus ou moins dessiné la prochaine feuille de route qu’emprunterait son pays sur le plan technologique. Les avancées indéniables de l’intelligence artificielle, bien balbutiantes à l’époque, avait structuré l’ensemble du discours du Président. Prenant comme exemple, l’expérimentation des voitures Uber sans conducteur dans cette même ville, Obama avait pointé du doigt les défis complexes que son pays allait devoir relever dans les prochaines années. Même si cette avancée technologique avait des conséquences positives, la voiture sans conducteur en aurait aussi de négatives. Pour Barack Obama, l’objectif était clair : personne ne devait être laissé pour compte. Il affirmait aussi que ses successeurs à la Maison-Blanche gouverneraient un pays transformé par l’IA.

Parallèlement, le gouvernement américain avait publié sur son site un livre blanc au titre très explicite : Preparing for the future of artificial Intelligence dans lequel il listait 23 recommandations visant à mettre l’IA au cœur des investissements et de la recherche publique.

Les Américain·es ont une certaine faculté à faire des prophéties auto-réalisatrices. Et lorsqu’ils veulent dessiner le futur de leur pays, ils se donnent les moyens pour y parvenir, sans forcément réfléchir aux conséquences sur le reste du monde.

James C. Scott définit cette attitude de haut-modernisme : une confiance absolue afin de faire advenir un progrès social permanent et un contrôle rationnel absolu de la nature.

Ce haut-modernisme est la vision portée par la « version forte (on pourrait même dire musclée) de la foi dans le progrès scientifique et technique associé à l’industrialisation », qui conçoit la société comme un « objet réifié séparé de l’état et pouvant être décrit scientifiquement ». Ce haut-modernisme est autoritaire dans la mesure où il prétend intervenir sur la condition humaine et la vie en société, au nom du progrès, de la science, de la technique, de la rationalité et de l’ingénierie sociale. Seuls ceux ayant une capacité à se projeter dans l’avenir sont en mesure de gouverner (élites, avant-gardes), quitte à restreindre le débat politique et à dévaluer la vie démocratique. La foi dans le progrès sert d’argument pour justifier des sacrifices à court terme au nom d’un avenir meilleur.

N’oublions pas qu’OpenAI a été cofondé, en partie, par la mafia Paypal et même si Elon Musk a depuis quitté la société, ses comparses Peter Thiel et Reid Hoffman y sont toujours. Or, comme vous le savez (ou pas), ces personnes ne cachent pas leur sympathie pour l’alt-right.

A la lueur donc de cet essai, et de ce qu’est l’IA génératrice, nous avons laissé une bande de prédateurs s’approprier un espace qui se voulait d’abord démocratique et indépendant. Nous avons tout implement échoué à faire vivre la déclaration d’indépendance du cyberespace : ChatGPT n’est que le énième avatar de prise de contrôle, qui, couplé avec la cybersurveillance, nous réduira à des indvidus spectateurs de nos propres vies, nous battant contre des travailleurs, payés une misère, pour nettoyer nos frustrations haineuses du Net.

Bienvenue en enfer.